正反対の「AI戦略」…NAVERは「大規模」vsKakaoは「小規模」

正反対の「AI戦略」…NAVERは「大規模」vsKakaoは「小規模」

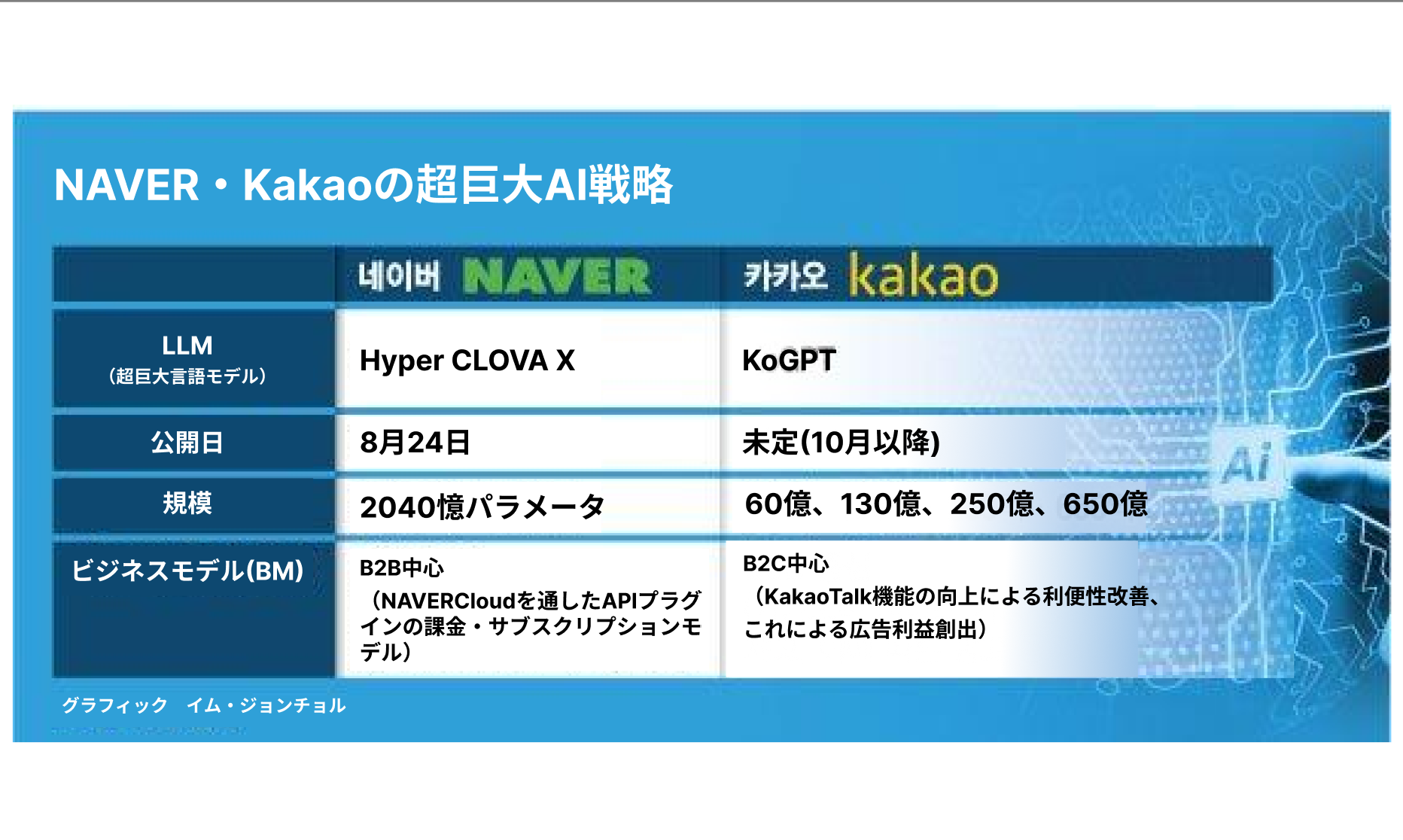

韓国の2大ポータル企業であるNAVER(228,000ウォン▼6,500 -2.77%)とKakao(52,300ウォン▼400-0.76%)が、第2四半期の決算発表で、未来ビジネスであるAI(人工知能)基盤モデルの戦略を明らかにした。検索ポータルサイトを中心に膨大なデータを蓄積してきたNAVERは、これらのデータと自社クラウドに合わせた大規模モデルに注力するのに対し、モバイルアプリを中心に事業を継続してきたKakaoは、スマートフォンでもスピーディーに動く軽量モデルに焦点を当てるという。

まずNAVERは、大規模モデルの高性能なAPI(アプリケーションプログラミングインタフェース)やプラグイン(Plug-in)を販売するB2B(企業間)サービスを先にリリースするという。一方Kakaoは、軽くて経済的なモデルを基盤に、Kakao talkの機能を高度化させるB2C(消費者直接取引)サービスを先にリリースする計画だ。

NAVERのキーワード:GPT向け・大規模モデル·B2B

NAVERが24日に披露するLLM(超大規模言語モデル)「HyperCLOVA X(ハイパークローバX)」は、膨大な学習量を誇るAIモデルだ。パラメーター(媒介変数)は2,040億と、ChatGPTのGPT-3.5(1,750億)よりも多く、韓国語の学習量はGPT-3の6,500倍以上だ。

これだけの規模を誇るHyperCLOVA Xは、OpenAI-MicrosoftのGPTモデルと同様の商用化戦略を採用することが予想されている。OpenAIとMicrosoftは、GPT-3.5およびGPT-4モデルのAPIとプラグインをMicrosoft Azure Cloud(マイクロソフト アジュール クラウド)などにより、他の事業者に販売することで収益を得ている。高性能LLMを必要とする企業は、このような方法でGPTモデルを使用することになる。

NAVERも、NAVER Cloudを通じてHyper CLOVA XのAPIやプラグインを販売することに注力する予定だ。NAVERのチェ・スヨン代表は、今月4日の2023年第2四半期業績発表会議で、「APIベースの課金モデルやサブスクリプションモデルも検討しており、NAVERのNeuro cloud(ニューロクラウド)技術を使用している業界との提携、企業との協業を通じて、収益結果がより早く出ることを期待している。」と述べた。

OpenAIが、ChatGPTでGPT-3.5やGPT-4モデルの性能を披露した後に、APIやプラグインの販売需要を伸ばしたように、NAVERも今年9月に生成型AIベースの検索サービス「Cue:(キュー)」でHyper CLOVA Xの性能を一般公開し、幅広い顧客を獲得する戦略だ。

Kakaoのキーワード:メタ向け・軽量モデル·B2C

今年第4四半期にKakaoが公開する予定のLLM「KoGPT(仮称)」は、最大650億パラメーターの経済的なモデルになると予想されている。大規模で高性能なAIモデルも良いが、問題はこれらのモデルの費用が高すぎるという点にある。OpenAIのAPI利用料は、1,000トークン(英単語約750語)でGPT-3.5モデル0.002ドル(約0.3円)、GPT-4モデル0.03ドル(約4.3円)だ。モデルが大きくなり、性能が向上するほど、利用料が倍に高くなる。

このような理由で、Kakaoはコストを削減できながらモバイルサービスに適したサイズのモデルを準備している。現在社内でテスト中のモデルは、パラメーター規模△60億、△130億、△250億、△650億の4つだ。これは、Meta(メタ{旧Facebook})がLLaMA2(ラマ2)のモデルを△70億、△130億、△700億、のサイズでリリースした方法に似ている。LLMモデルをGithub(ギットハブ)やHugging Face(ハギングフェイス)にオープンソースとして公開するという方針も似ている。

Kakaoは、このモデルをKakaoTalkサービスに適用して、まずはKakaoTalkを使用しているB2C顧客の利便性を向上させる計画だという。APIやプラグインを直接販売するのではなく、AIを適用したサービスを提供し、これを通じて収益を出すという戦略だ。たとえば、中・小規模事業主がAIを活用して、ユーザーにパーソナライズされたKakao Talkメッセージを配信したり、注文や予約などの取引型サービスにもAIを適用するという方法だ。B2Bについては、「KoGPT APIの販売など、B2B製品はまだ計画されていない。」とKakaoの関係者は述べている。

Kakaoのホン・ウンテク代表は今月3日、第2四半期業績発表会議で、「Kakao Talkアプリのメッセージを要約するためには、60億パラメーターの軽量モデルがコスト的に妥当だ。」とし「どの企業がLLMを最初に構築するかの問題ではなく、どれだけリーズナブルなコストでモデルを作り、サービスに適用できるかのゲームになるだろう。」と強調した。

多様化するAIファウンデーションモデル…勝者の独占を防ぎ、多様な需要に対応

NAVERとKakaoが異なるAI戦略を取っていることについて、専門家は肯定的な意見だ。OpenAIやGoogleなどの世界的なリーディング企業がファウンデーションモデルを独占することなく、さまざまな需要に対応できるからだ。AI研究の世界トップ4の1人であるアンドリュー・エン教授は、先月20日に京畿道城南市に位置するKakao板橋アジトで行われた座談会で、「さまざまなデータとユースケースに合わせて、最適化されたモデルが分けられるだろう。」と予測した。

ソウル大学コンピューター工学部のチャン・ビョンタク教授(AI研究所所長)は、「私は(パラメーターの規模が)大きいモデルが好きだ。ただ、GPUや電気を多く使うというデメリットがあるので、多様に応用するためには小型モデルも必要だ。」とし「非常に大きなモデルを小型・軽量化することも新しい技術であり、産業的にもインパクトがあるので、たくさんの研究を行っている。NAVERとKakaoのAI戦略は異なるが、それぞれ重要な意味を持っている。」と述べた。

原文:https://www.unicornfactory.co.kr/article/2023080716594958023

2021年に発足したUNICORN FACTORY(ユニコーンファクトリー)は、MONEY TODAY(マネートゥデイ)が韓国の総合誌で初めてスタートさせたスタートアップ専門のメディアプラットフォームです。 溢れるニュースの中でスタートアップ生態系に必要なニュースだけを厳選し深く伝えます。

関連記事

-

外国人起業家による「K-ユニコーン」が人口問題解決の鍵となるか

#UNICORN FACTORY #スタートアップ #韓国 #人材 -

Kakao InvestmentがDX促進中の日本に注目…専門家マッチングプラットフォーム「ゼヒトモ」に投資

#UNICORN FACTORY #ベンチャーキャピタル #スタートアップ #DX #グローバル進出 -

個性的なグッズで体験するスタートアップブランド

#Platum #スタートアップ #EC #イベント -

babygo、2024年上半期のアプリ活性化の成果が目立つ

#Platum #アプリ #ライフスタイル -

Maximizer、創業から2年で累積取扱高700億ウォン

#Platum #マーケティング #アドテック #スタートアップ -

Youtubeアプリ、韓国人のスマートフォンアプリデータ使用量全体の42%占める

#Platum #アプリ #韓国